Misc 126

USB - Votre pire ennemi ?

Un vecteur d’attaque souvent négligé…

- Outillage pour l’analyse et l’attaque des périphériques USB

- Analyse du risque des clefs USB malveillantes

- Conception et piégeage d’un câble USB

12,90 € TTC

Anciens Numéros

Pentest Corner

p. 06 Accélérer un pentest avec des outils d’observabilité

Malware Corner

p. 12 Raspberry Robin : vous prendrez bien un dernier ver ?

IoT Corner

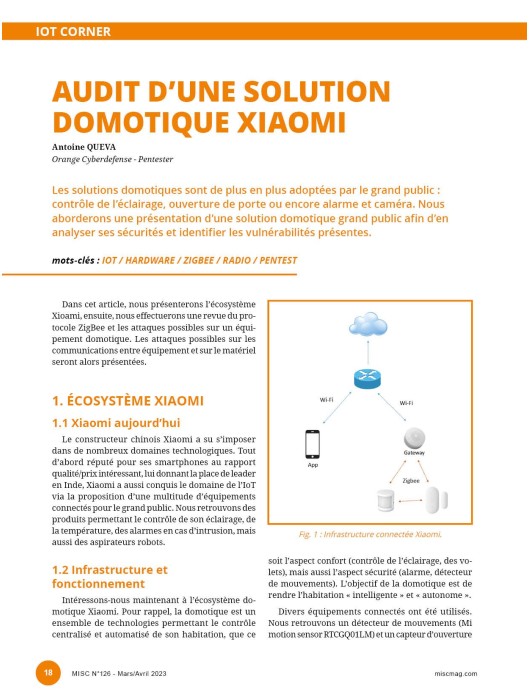

p. 18 Audit d’une solution domotique Xiaomi

Dossier : USB - Votre pire ennemi ?

p. 28 Introduction

p. 29 Comment attaquer un port USB ?

p. 42 USB Samouraï

p. 48 USB Drop Attacks

Système

p. 56 Secure Boot : à quoi bon ?

p. 64 Attaques par direct memory access et sécurité hardware

Cryptographie

p. 76 Cryptojacking

Tout le monde s’était habitué à ce que les machines reconnaissent des images, la voix et des instructions passées à l’oral ou à l’écrit avec plus ou moins de succès, mais les exemples d’IA génératives accessibles au public étaient jusqu’à fin 2022 peu enthousiasmants. ChatGPT a marqué l’apparition auprès du public d’avancées développées depuis quelques années en matière d’IA, mais qui étaient restées dans les laboratoires.

ChatGPT est en en particulier très utile dans le domaine de l’informatique et a immédiatement surpassé GitHub Copilot dans le domaine de la rédaction de code assistée par l’IA. ChatGPT offre des fonctionnalités étonnantes, telles que la conversion de code d’un langage à un autre, la refactorisation, l’optimisation, l’analyse de code pour comprendre son fonctionnement, la détection de bugs, l’écriture de tests unitaires en encore la rédaction automatisée de code. Les possibilités sont énormes et peuvent faire économiser du temps aux développeurs.

Si, dans le domaine de la sécurité offensive, ChatGPT peut déjà démontrer une certaine utilité pour écrire rapidement des scripts automatisant certaines tâches, le fait qu’il ait été bridé pour réduire le risque d’un usage offensif bloque rapidement le pentester. D’une part, il refuse d’écrire certains types de code, comme si vous lui demandez d’écrire un programme qui va copier son code dans d’autres fichiers, et d’autre part, il possède des limitations techniques concernant les performances des API limitant les requêtes intensives.

Les potentiels dans le domaine de la sécurité offensive sont effrayants et ouvrent de nouvelles perspectives sur ce que l’IA peut accomplir. Automatisation de la création de malwares avec des équipes techniques réduites ou astroturfing en s’affranchissant des usines à trolls en sont quelques exemples. De plus, l’IA pourrait également permettre la réalisation d’attaques de manière entièrement automatisée à grande échelle. Bien que la reconnaissance des cibles puisse déjà être effectuée par des scripts, l’attaque elle-même nécessite souvent encore une intervention manuelle en raison de la variété des environnements. Une IA correctement formée avec les outils adéquats pourrait automatiser toutes les étapes de la compromission, éliminant ainsi la nécessité de mobiliser une équipe pendant des semaines pour atteindre une cible. Dans ce scénario, une petite équipe de criminels en ligne correctement outillée pourrait disposer des capacités offensives qui ne sont actuellement accessibles qu’à une armée de combattants en cybersécurité opérant au niveau d’un État.

Évidemment, pour le côté blue team, le développement de l’IA va nécessairement améliorer les mécanismes de détection et automatiser la mise en place de mesures de protection. Les RSSI peuvent rêver que leur SOC managé, grevant si douloureusement leur budget, pourra être bientôt remplacé par une simple brique logicielle qui analysera en toute autonomie les événements de sécurité et pourra isoler un terminal suspect sans aucune intervention humaine.

Le développement de l’IA dans le domaine de la cybersécurité risque d’être passionnant. ChatGPT a levé le voile sur les possibilités offertes par l’IA dès aujourd’hui et nous pouvons parier sur des ruptures technologiques prochaines dans le domaine de la sécurité pour le meilleur et pour le pire.

Cédric Foll / cedric@miscmag.com / @follc

La publication technique des experts de la sécurité offensive & défensive

Face à la transformation digitale de notre société et l’augmentation des cybermenaces, la cybersécurité doit être aujourd’hui une priorité pour bon nombre d’organisations. Après plus de 20 années de publications et de retours d’expérience, MISC apporte un vivier d’informations techniques incontournable pour mieux appréhender ce domaine. Précurseur sur ce terrain, MISC a été fondé dès 2002 et s’est peu à peu imposé dans la presse française comme la publication de référence technique en matière de sécurité informatique. Tous les deux mois, ses articles rédigés par des experts du milieu vous permettront de mieux cerner la complexité des systèmes d’information et les problèmes de sécurité qui l’accompagne.